StoryMem

Narrativa de Vídeo Longo Multi-take com Memória

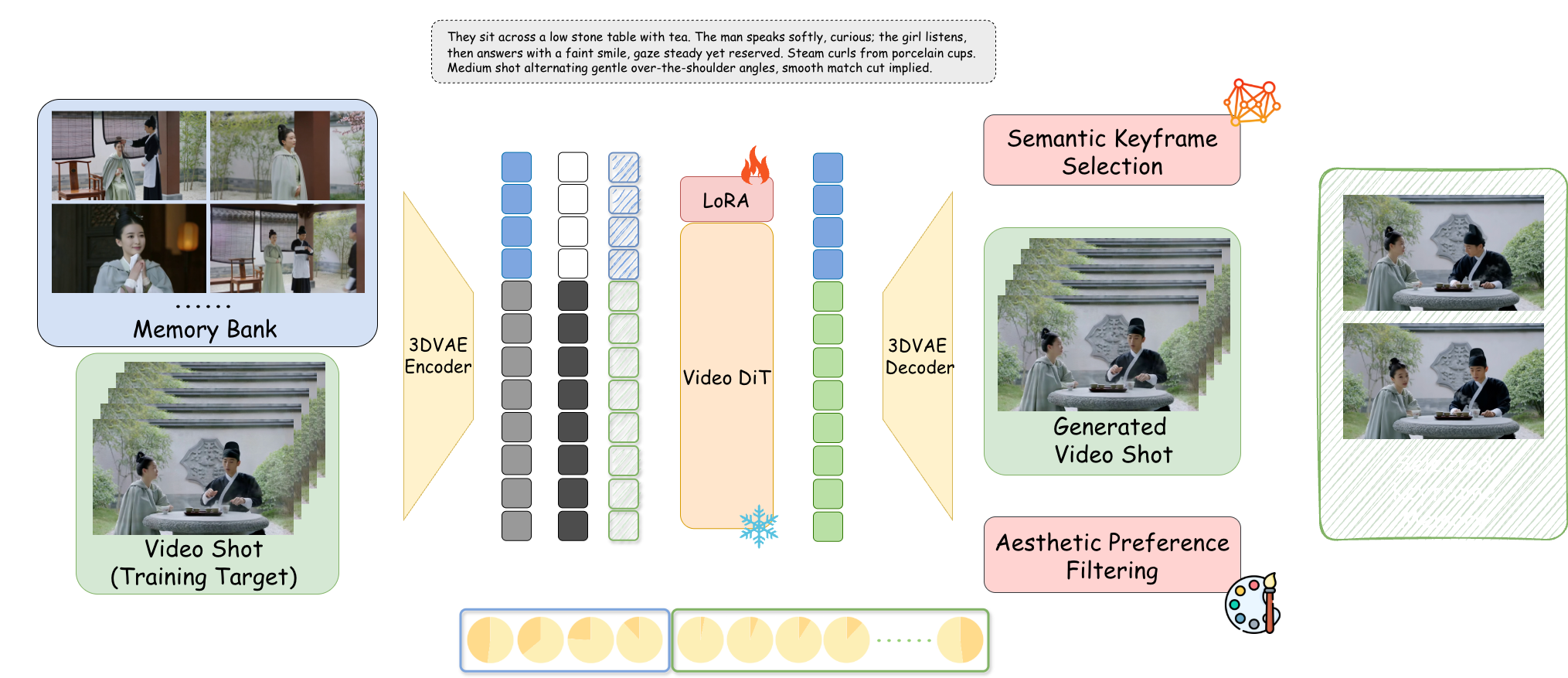

Da "geração aleatória" ao "pensamento de diretor". Através de Bancos de Memória Visual Explícitos e tecnologia de Deslocamento RoPE Negativo, StoryMem resolve o problema do "esquecimento" na narrativa multi-take, alcançando consistência cinematográfica entre tomadas.

Avanços Fundamentais e Evolução

A "Terceira Via" da Tecnologia de Geração de Vídeo

Dor Central: "Esquecimento" Multi-take

Modelos DiT existentes tratam cada geração como um processo aleatório independente. Ao cortar de "plano geral" para "close-up", características em nível de pixel (penteado, textura da roupa) frequentemente sofrem mutação, quebrando a imersão.

Banco de Memória Explícito

Além da Modelagem Conjunta de alto custo computacional e auto-regressão simples. StoryMem estabelece um módulo de memória dinâmico independente do processo de geração, mantendo o contexto narrativo como a memória de trabalho humana.

Deslocamento RoPE Negativo

Singularidade Tecnológica: Ao atribuir índices de tempo negativos aos quadros de memória, cria um mecanismo de atenção "semanticamente conectado, mas espaciotemporalmente desconectado". Simula perfeitamente Cortes Secos (Hard Cut) de filme, retendo identidade enquanto reinicia o movimento.

Mergulho Profundo na Arquitetura M2V

Construção do Banco de Memória

Baseado no ajuste fino Wan2.2-I2V + LoRA. Usa mecanismo de filtragem inteligente, mantendo apenas quadros-chave das últimas 10 tomadas ativas, simulando a "memória de trabalho" humana para evitar exaustão de VRAM.

Seleção Semântica de Quadros-chave

Introduz modelo CLIP para calcular similaridade de cosseno. Armazena apenas quadros que melhor refletem as descrições atuais do roteiro (ex: "expressão zangada"), descartando quadros intermediários borrados ou piscando.

Filtragem de Preferência Estética

Integra modelo de pontuação HPSv3 como "Diretor de Arte IA". Filtra quadros colapsados em tempo real, garantindo que apenas material de alta qualidade estética permaneça na memória.

Concatenação de Espaço Latente

Quadros de memória são comprimidos em Latents via VAE 3D, concatenados com vetores de ruído atuais na dimensão do canal, e injetados via adaptador LoRA Rank=128.

Avaliação Autoritativa ST-Bench

Avaliação quantitativa baseada em 300 prompts narrativos multi-take

Baseado no cálculo de similaridade de cosseno ViCLIP, quantificando com precisão a capacidade de retenção de identidade do protagonista.

Pontuação do preditor estético LAION, provando que o módulo de memória não degradou os padrões artísticos.

Mecanismo de memória não interferiu na compreensão do modelo de novas instruções, respondendo com precisão a mudanças de roteiro.

Narrativa Roteiro-para-Vídeo (Script-to-Video)

Entrada de roteiro estruturado JSON, controle tomadas como um diretor

Sonho no Pavilhão Vermelho: Daiyu Entra

AtmosphericComparação e Posicionamento

Comparado a modelos como Open-Sora focados em simulação física, StoryMem foca em Lógica Narrativa Cinematográfica.

❌ Processo Aleatório: Aparência do personagem sofre mutação com mudanças de tomada, modelo não consegue manter imagem consistente.

✅ Injeção de Memória: Mesmo sob diferentes ângulos e iluminação, detalhes estruturais (olhos, cor) permanecem altamente consistentes.

vs. Sora / Open-Sora

Sora tende a gerar um único vídeo longo contínuo. StoryMem busca Sequências Narrativas compostas por tomadas de 5-10s, adequando-se a pipelines de edição de filme profissional.

vs. AnimateDiff

AnimateDiff se destaca em loops estilizados, mas cria transições de morphing durante "Cortes Secos". StoryMem resolve isso perfeitamente via RoPE negativo.

vs. IP-Adapter

IP-Adapter depende de uma única imagem de referência, propenso a colapsar em dinâmicas complexas. O banco de memória dinâmico do StoryMem captura características multi-ângulo.

StoryMem prova que a "Memória" é chave para realizar narrativa inteligente avançada. Embora atualmente limitado pela qualidade do modelo base (ex: detalhes das mãos) e custos de VRAM (24GB recomendado), abre a porta para "Estúdios de Cinema Unipessoais".

Perspectivas Futuras: Introduzir Bancos de Memória de Áudio para consistência de voz; explorar possibilidades de geração infinita para Filmes Interativos e Jogos com renderização em tempo real.

📄 Ler Paper Completo (ArXiv)