摘要

雖然現代人工智慧在從影片生成音訊方面取得了巨大進展,

但創建真正符合視覺內容細微差別的高保真聲音仍然是一個主要障礙。

專業的音效設計需要對視覺線索、聲學和時機進行複雜的推理——這項技能在人工智慧中很難複製。

本文介紹了ThinkSound,這是一個開創性的框架,

教人工智慧像音效設計師一樣「思考」。透過使用思維鏈(CoT)推理,

ThinkSound將複雜的音訊生成任務分解為合乎邏輯、易於管理的步驟。

這不僅可以從頭開始創建聲音,還可以使用簡單的自然語言命令進行互動式、

以物件為中心的編輯和優化。為了支援這一點,我們還提出了AudioCoT,

這是首個為此類推理過程訓練模型而設計的資料集。

我們的實驗表明,ThinkSound在音訊品質和相關性方面都樹立了新的技術水平,

即使在複雜的、分佈之外的電影場景中也表現出色。

與影片生成模型的協同作用

ThinkSound無縫地為領先的生成模型創建的影片添加豐富、同步的音景。以下影片由其各自的模型生成;所有音訊均由ThinkSound創建。

Veo + ThinkSound

Sora + ThinkSound

MovieGen + ThinkSound

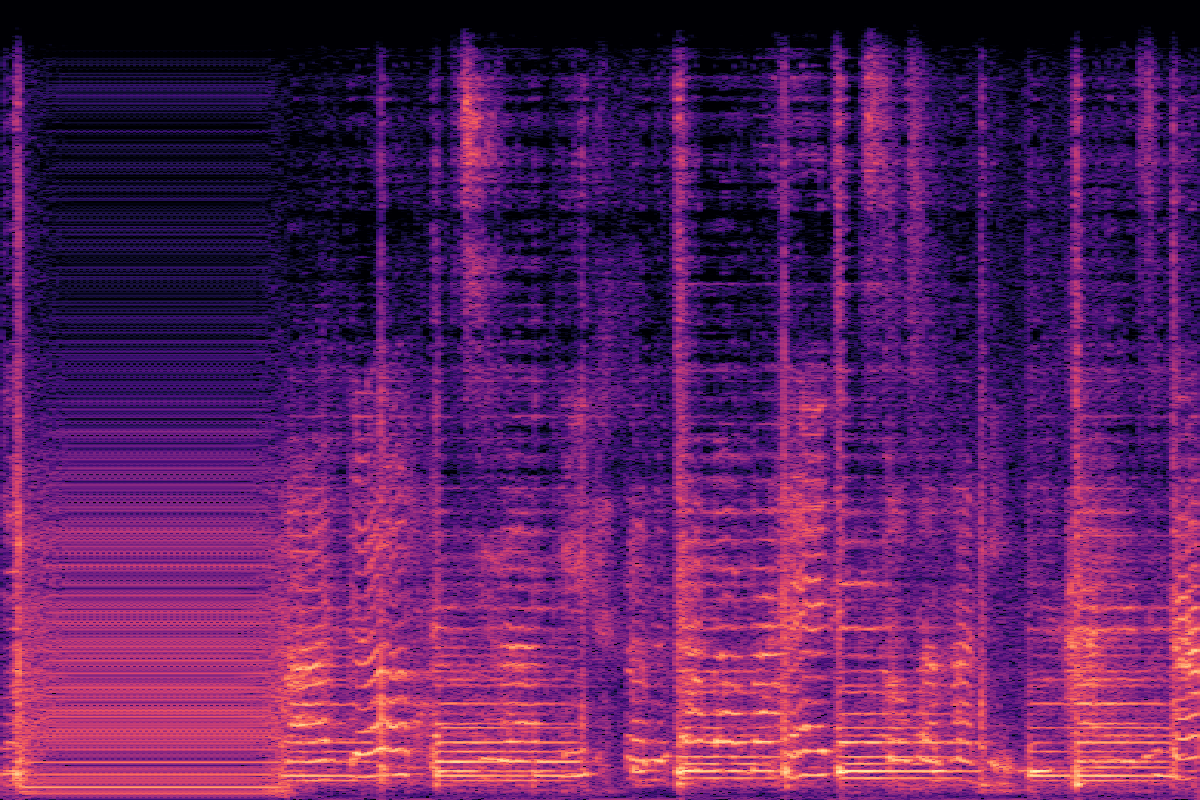

在VGGSound上的V2A比較(分佈內)

點擊任何縮圖以載入和播放影片,將ThinkSound與其他模型進行比較。

| CoT | 真實情況 | ThinkSound | MMAudio | See&Hear |

|---|---|---|---|---|

| 打網球 生成網球拍擊球和球彈跳的聲音... |  |  |  |  |

| 印表機列印 生成帶有週期性蜂鳴聲的連續印表機列印聲... |  |  |  |  |

| 撕紙 從紙張被撕開的細微撕裂聲開始... |  |  |  |  |

| 使用縫紉機 生成帶有持續縫紉機嗡嗡聲的環境縫紉室聲音... |  |  |  |  |

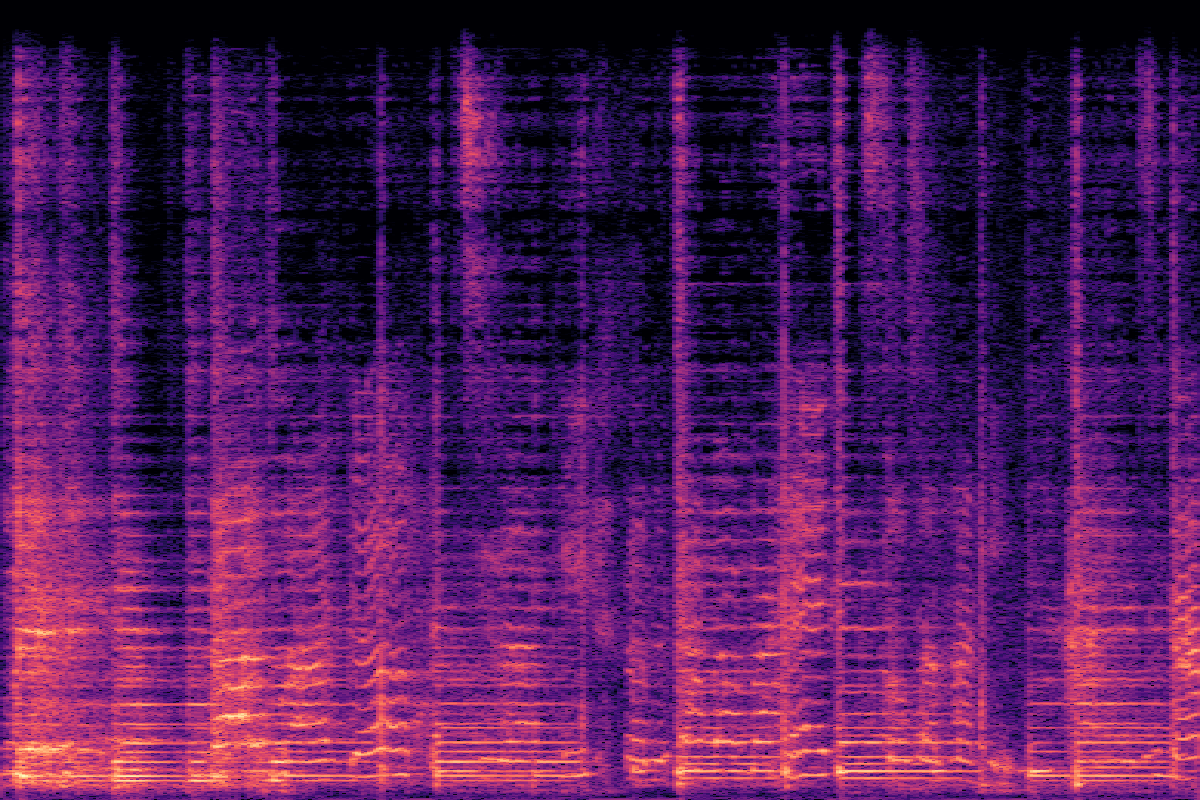

在MovieGen Audio上的V2A比較(分佈外)

了解ThinkSound在具有挑戰性的、分佈之外的電影剪輯上的表現。

| CoT | ThinkSound | Movie Gen Audio | MMAudio |

|---|---|---|---|

| 輕柔的吸吮聲 輕柔、穩定的奶嘴吸吮背景聲... |  |  |  |

| 和諧的弦樂 原聲吉他弦的嗡嗡聲和蜂鳴聲... |  |  |  |

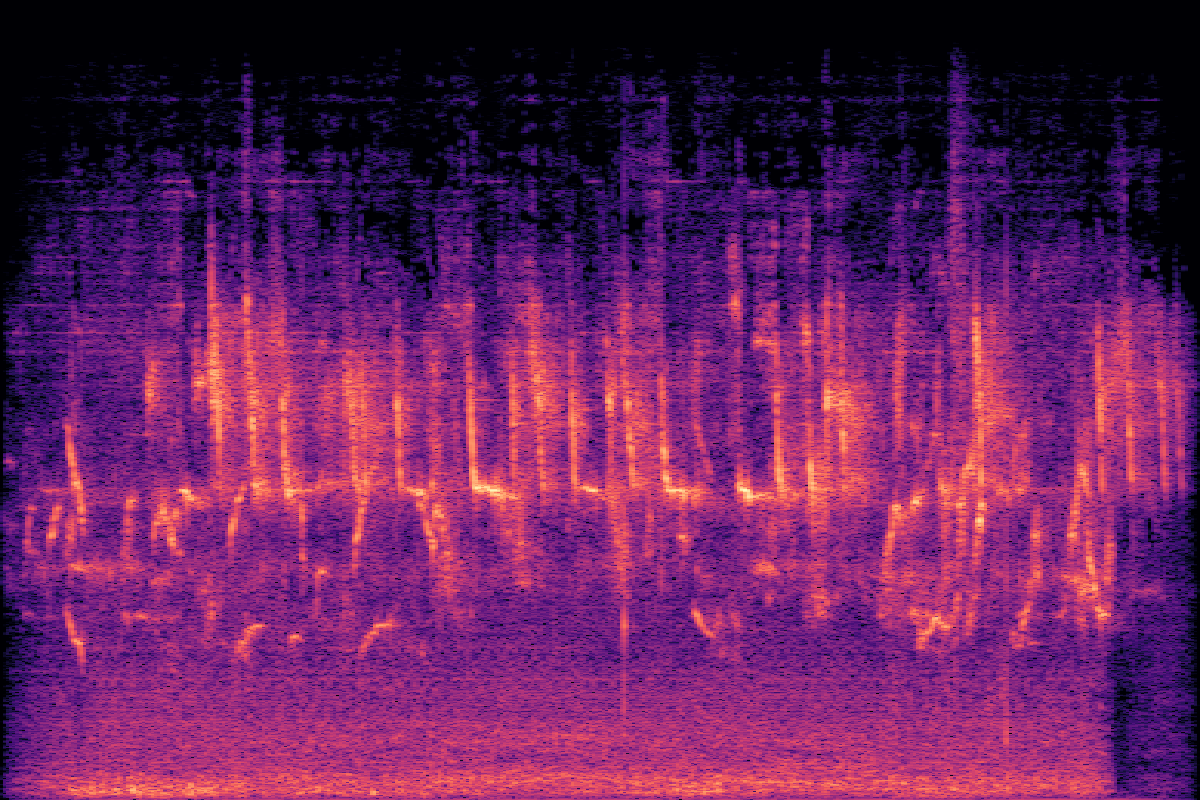

| 舊電視的嗡嗡聲 帶有微弱靜電和白噪音的環境背景噪音... |  |  |  |

| 強烈的雷聲 低沉的風聲和偶爾的噼啪聲增添了暴風雨的氣氛... |  |  |  |

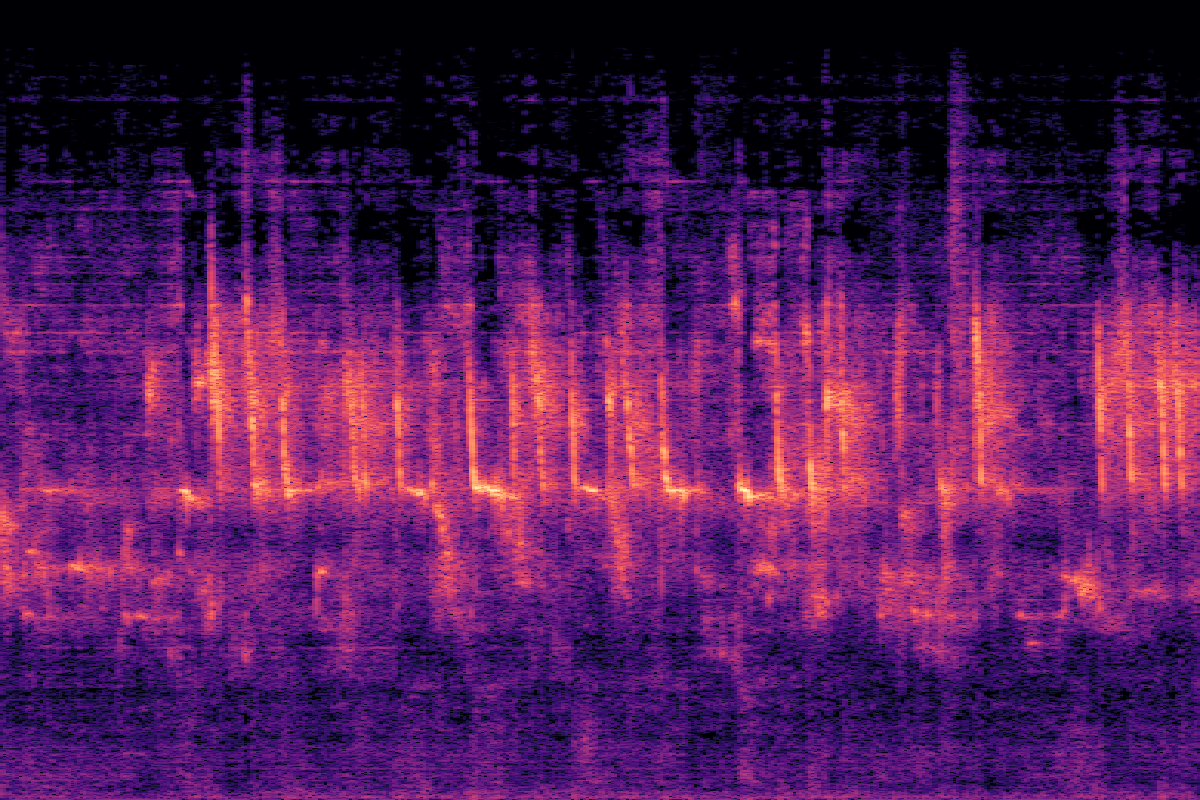

互動式分步擬音創作

V2A生成 → 物件聚焦 → 音訊修復

V2A生成 → 物件聚焦 → 音訊編輯

實驗

在VGGSound上的主要結果

ThinkSound在大多數客觀指標和所有主觀指標上均優於所有基準,在音訊品質和語義對齊方面取得了顯著的改進。

| Method | Objective Metrics | Subjective Metrics | Efficiency | |||||||

|---|---|---|---|---|---|---|---|---|---|---|

| FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAPcap ↑ | CLAPCoT ↑ | MOS-Q ↑ | MOS-A ↑ | Params | Time(s) ↓ | |

| GT | - | - | - | 0.55 | 0.28 | 0.45 | 4.37±0.21 | 4.56±0.19 | - | - |

| See&Hear | 118.95 | 2.26 | 2.30 | 1.20 | 0.32 | 0.35 | 2.75±1.08 | 2.87±0.99 | 415M | 19.42 |

| V-AURA† | 46.99 | 2.23 | 1.83 | 0.65 | 0.23 | 0.37 | 3.42±1.03 | 3.20±1.17 | 695M | 14.00 |

| FoleyCrafter | 39.15 | 2.06 | 1.89 | 1.21 | 0.41 | 0.34 | 3.08±1.21 | 2.63±0.88 | 1.20B | 3.84 |

| Frieren† | 74.96 | 2.55 | 2.64 | 1.00 | 0.37 | 0.34 | 3.27±1.11 | 2.95±1.09 | 159M | - |

| V2A-Mapper† | 48.10 | 2.50 | 2.34 | 1.23 | 0.38 | 0.32 | 3.31±1.02 | 3.16±1.04 | 229M | - |

| MMAudio | 43.26 | 1.65 | 1.40 | 0.44 | 0.31 | 0.40 | 3.84±0.89 | 3.97±0.82 | 1.03B | 3.01 |

| ThinkSound | 34.56 | 1.52 | 1.32 | 0.46 | 0.33 | 0.46 | 4.02±0.73 | 4.18±0.79 | 1.30B | 1.07 |

| w/o CoT Reasoning | 39.84 | 1.59 | 1.40 | 0.48 | 0.29 | 0.41 | 3.91±0.83 | 4.04±0.75 | 1.30B | 0.98 |

消融研究

我們研究了每個組件的貢獻,以驗證我們設計選擇的有效性,重點關注文本編碼和多模態整合。

文本編碼策略

| Method | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAP ↑ |

|---|---|---|---|---|---|

| CLIP | 39.84 | 1.59 | 1.40 | 0.48 | 0.41 |

| T5 (CoT) | 37.65 | 1.54 | 1.35 | 0.46 | 0.44 |

| CLIP + T5 | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

多模態整合

| Integration | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAP ↑ |

|---|---|---|---|---|---|

| audio only | 37.13 | 1.58 | 1.37 | 0.50 | 0.43 |

| linear video | 38.96 | 1.58 | 1.38 | 0.46 | 0.45 |

| gated video | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

模型大小的影響

| Size | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAPCoT ↑ |

|---|---|---|---|---|---|

| Small | 40.80 | 1.64 | 1.38 | 0.46 | 0.41 |

| Medium | 36.80 | 1.56 | 1.34 | 0.46 | 0.44 |

| Large | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

常見問題

ThinkSound是一個先進的人工智慧框架,旨在為影片生成和編輯音訊。與傳統模型不同,它使用一種稱為思維鏈(CoT)的推理過程來理解影片的上下文,並像專業音效設計師一樣創建高度相關、高品質的聲音。

思維鏈允許模型將複雜的任務(如「為此影片創建配樂」)分解為更小、更合乎邏輯的步驟。例如,它可能首先識別主要物件和動作,然後對環境的聲學進行推理,最後決定適當的聲音及其時機。這種循序漸進的過程可以實現更準確、更具上下文感知能力的音訊生成。

主要有三點:1)它使用CoT推理進行更智能的聲音創作。2)它的互動性,允許使用者使用自然語言編輯音訊、專注於特定物件並優化聲音。3)它由AudioCoT提供支援,這是一個專門為訓練這種基於推理的音訊生成而構建的獨特資料集。

可以!我們在此頁面頂部連結的Hugging Face Spaces上提供了互動式演示。您還可以在GitHub上探索原始碼以自行運行模型。