ThinkSound

Pioneros en la generación y edición de audio con razonamiento de cadena de pensamiento

Resumen

Si bien la IA moderna ha logrado grandes avances en la generación de audio a partir de video,

crear un sonido de alta fidelidad que realmente coincida con los matices del contenido visual

sigue siendo un obstáculo importante. El diseño de sonido profesional requiere

un razonamiento complejo sobre pistas visuales, acústica y sincronización, una habilidad que

ha sido difícil de replicar en la IA.

Este artículo presenta ThinkSound, un marco innovador

que enseña a la IA a "pensar" como un diseñador de sonido. Mediante el uso del razonamiento

de Cadena de Pensamiento (CoT), ThinkSound descompone la compleja tarea

de la generación de audio en pasos lógicos y manejables. Esto permite

no solo crear sonido desde cero, sino también la edición y el refinamiento interactivos

y centrados en objetos mediante simples comandos de lenguaje natural. Para potenciar esto,

también presentamos AudioCoT, un conjunto de datos único en su tipo

diseñado para entrenar modelos en este proceso de razonamiento. Nuestros experimentos muestran

que ThinkSound establece un nuevo estado del arte tanto en calidad de audio como en relevancia,

con un rendimiento excepcional incluso en escenas de películas complejas y fuera de distribución.

Sinergia con modelos de generación de video

ThinkSound agrega sin problemas paisajes sonoros ricos y sincronizados a los videos creados por los principales modelos generativos. Los videos a continuación fueron generados por sus respectivos modelos; todo el audio fue creado por ThinkSound.

Veo + ThinkSound

Sora + ThinkSound

MovieGen + ThinkSound

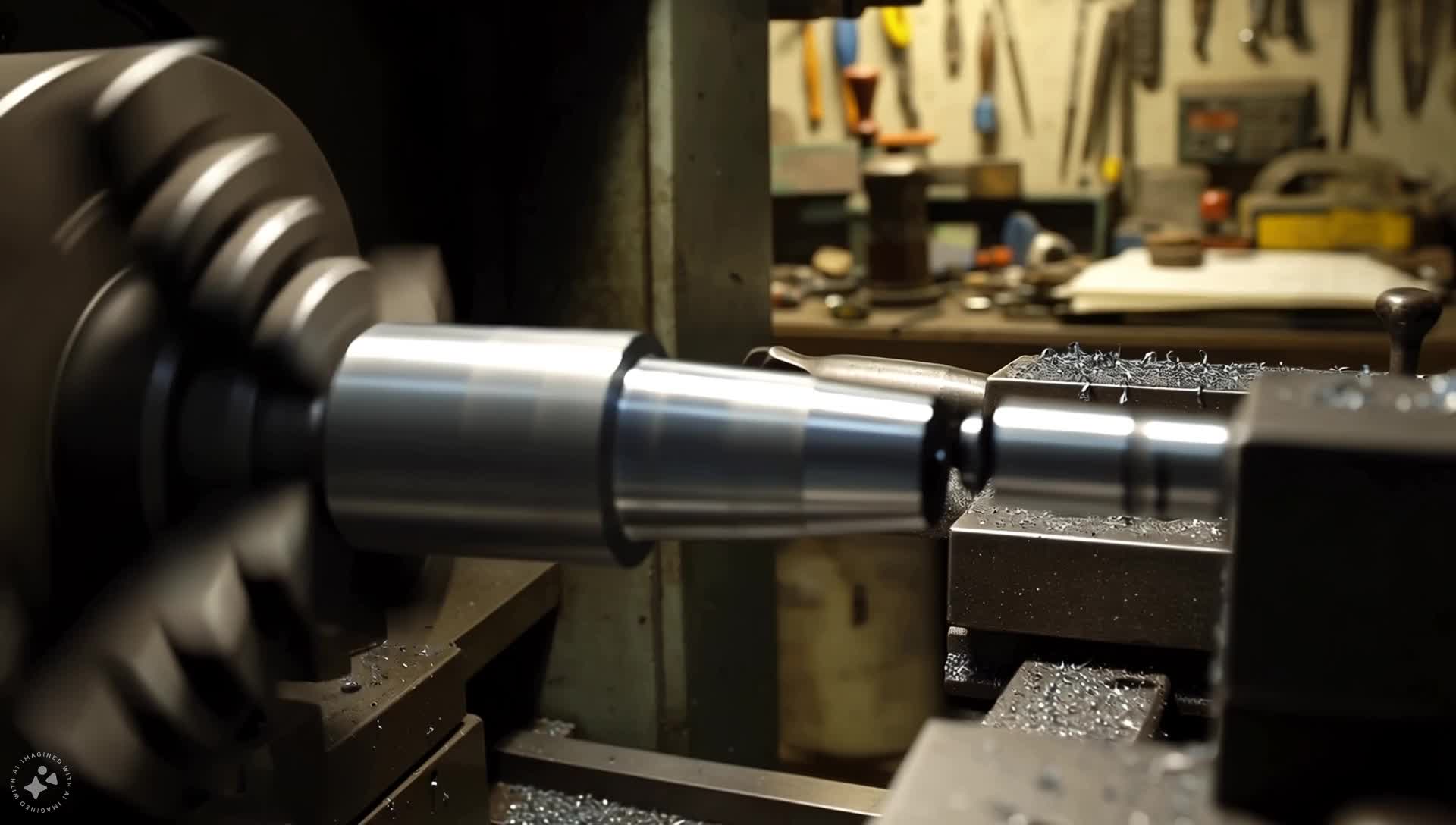

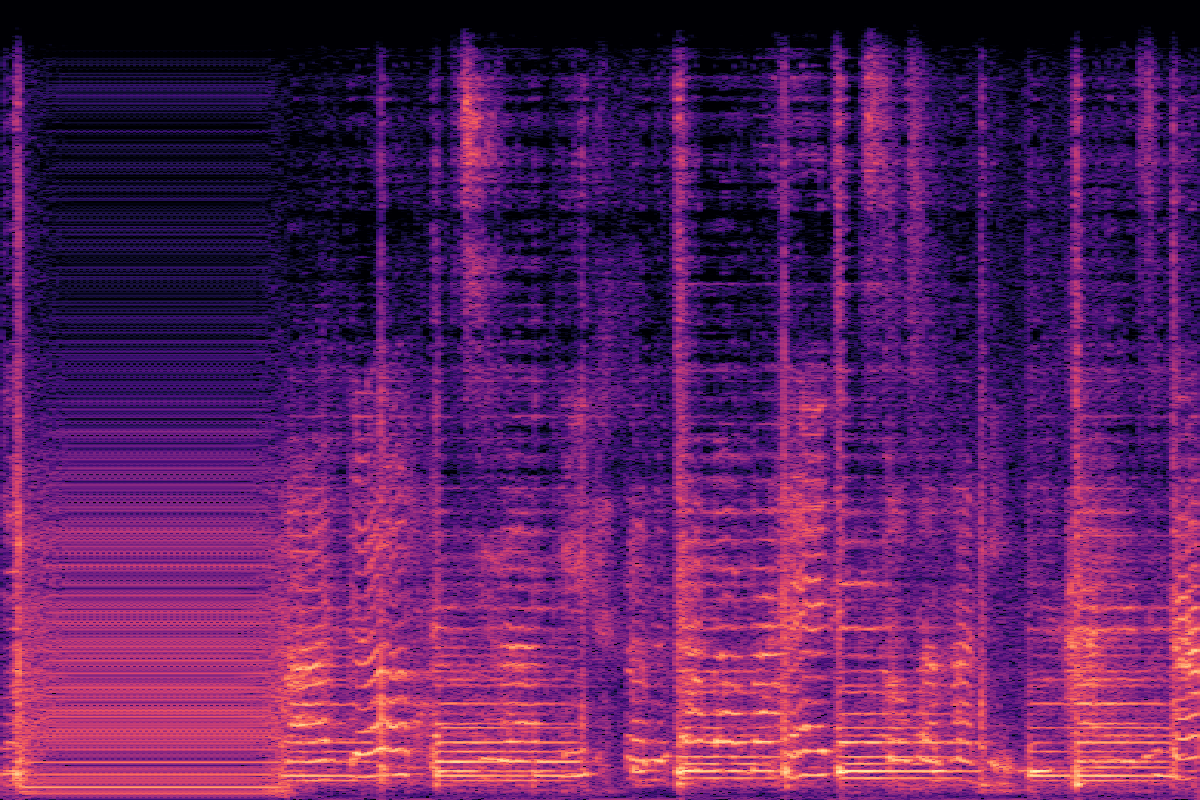

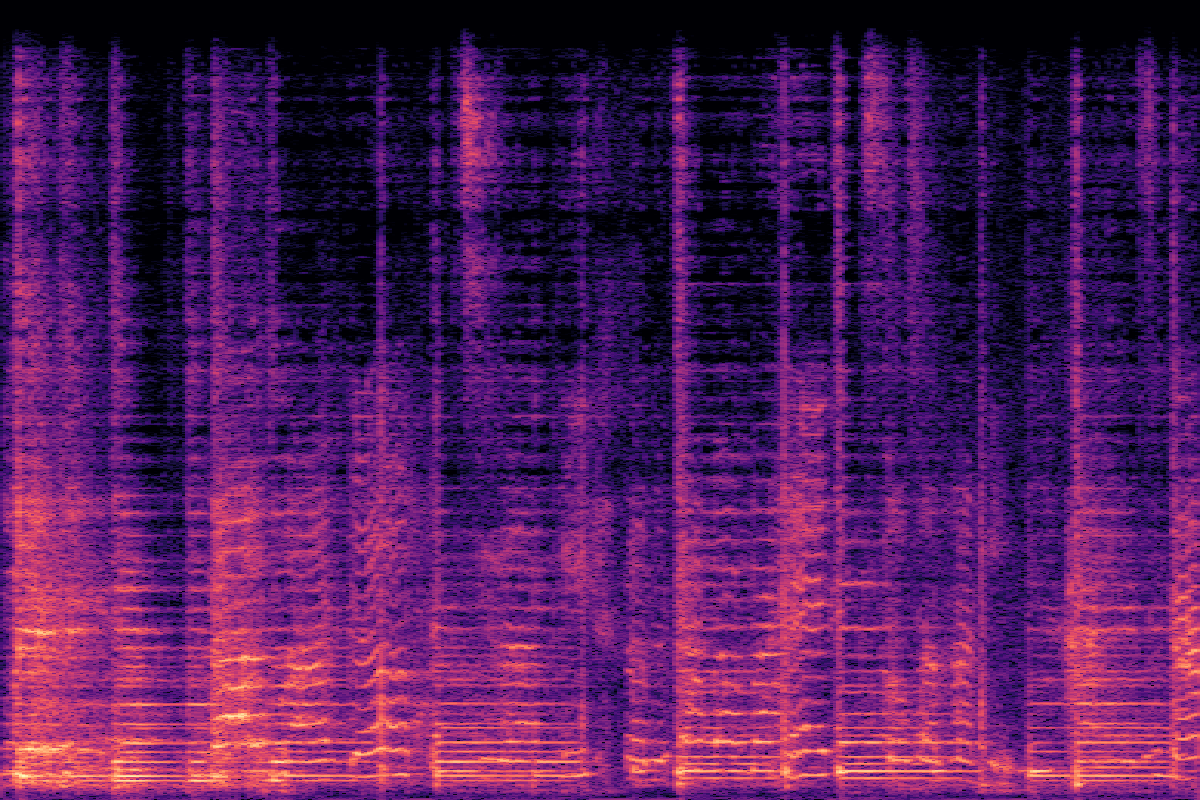

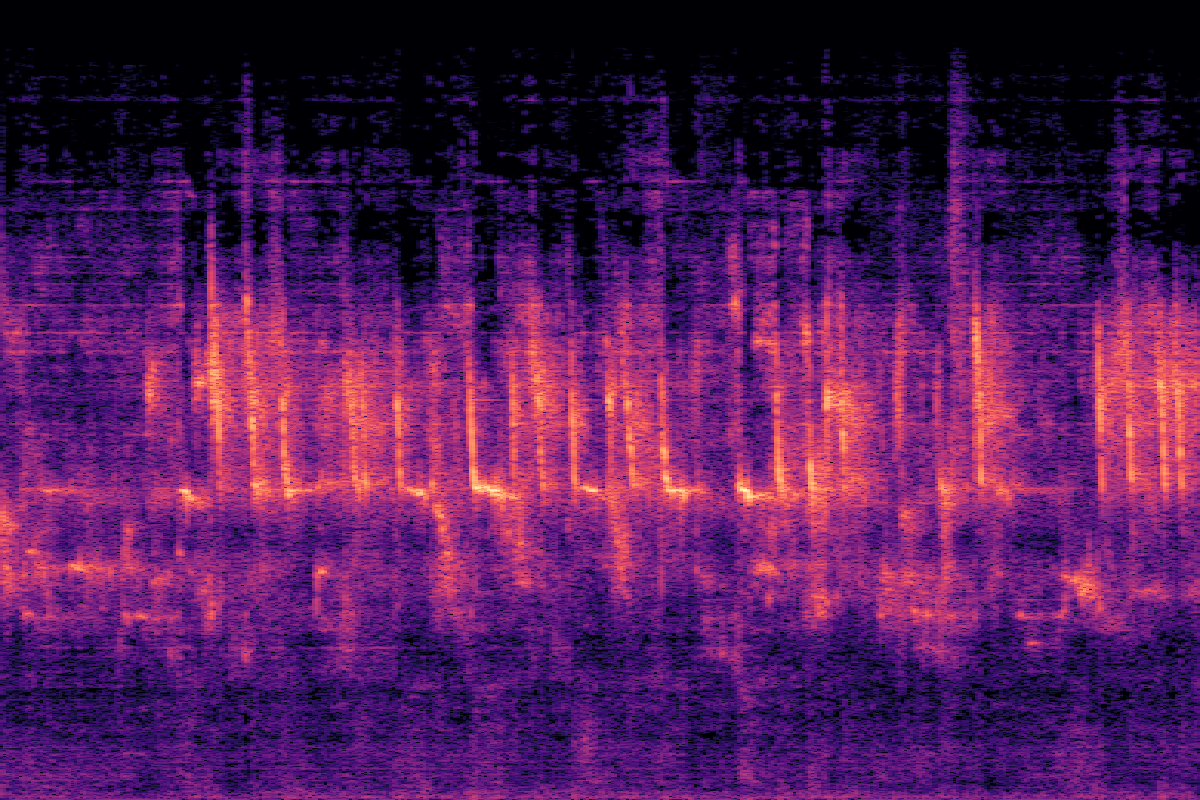

Comparaciones de V2A en VGGSound (en distribución)

Haga clic en cualquier miniatura para cargar y reproducir el video, comparando ThinkSound con otros modelos.

| CoT | Verdad fundamental | ThinkSound | MMAudio | See&Hear |

|---|---|---|---|---|

| Jugando al tenis Generar sonidos de tenis golpeando una raqueta y la pelota rebotando... |  |  |  |  |

| Impresora imprimiendo Generar un sonido continuo de impresora imprimiendo con pitidos periódicos... |  |  |  |  |

| Rasgando papel Comenzar con un sutil sonido de desgarro de papel al ser rasgado... |  |  |  |  |

| Usando máquinas de coser Generar sonidos ambientales de sala de costura con un zumbido constante de máquina de coser... |  |  |  |  |

Comparaciones de V2A en MovieGen Audio (fuera de distribución)

Vea cómo se desempeña ThinkSound en clips de películas desafiantes y fuera de distribución.

| CoT | ThinkSound | Movie Gen Audio | MMAudio |

|---|---|---|---|

| Sonidos suaves de succión Fondo suave y constante de succión ligera de chupete... |  |  |  |

| Cuerdas armoniosas Cuerdas de guitarra acústica zumbando y vibrando... |  |  |  |

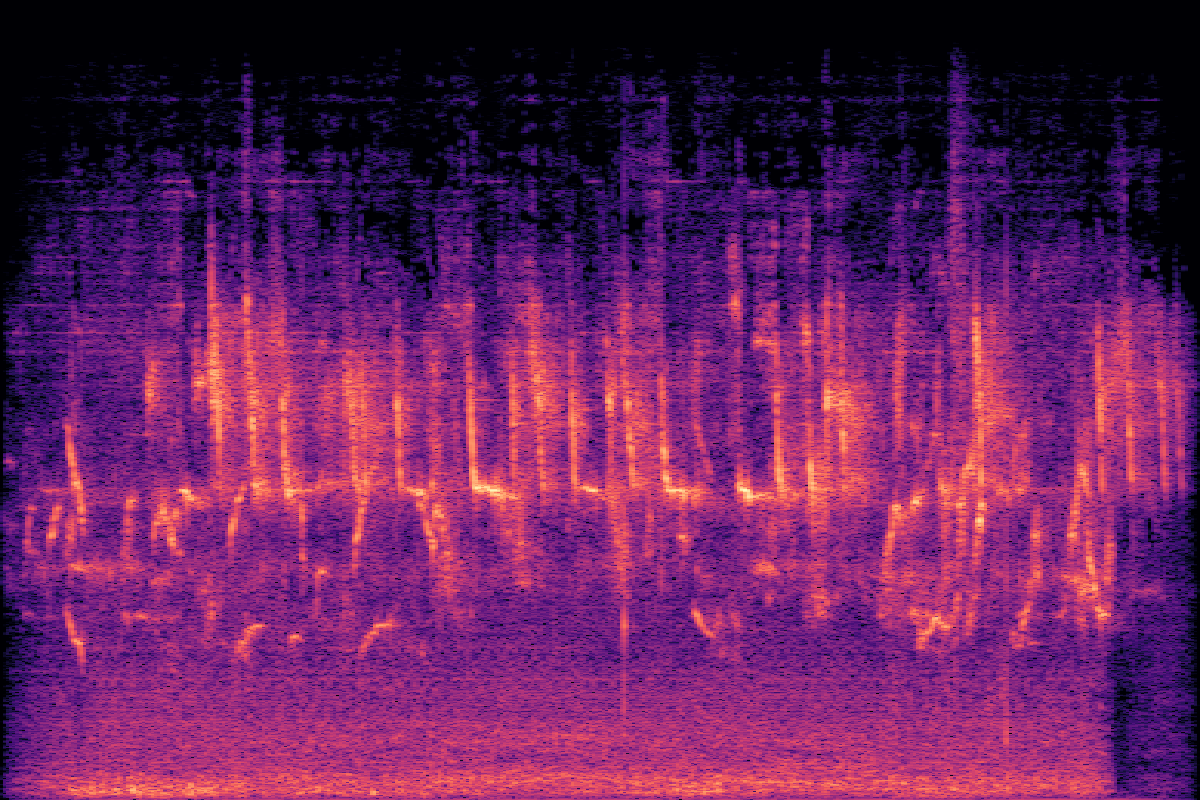

| Zumbido de televisor antiguo Ruido de fondo ambiental con estática débil y ruido blanco... |  |  |  |

| Trueno intenso Un zumbido de viento bajo y crujidos ocasionales se suman a la atmósfera tormentosa... |  |  |  |

Creación interactiva de Foley paso a paso

Generación V2A → Enfoque en el objeto → Inpainting de audio

Generación V2A → Enfoque en el objeto → Edición de audio

Experimentos

Resultados principales en VGGSound

ThinkSound supera a todas las líneas de base en la mayoría de las métricas objetivas y en todas las métricas subjetivas, logrando mejoras sustanciales en la calidad del audio y la alineación semántica.

| Method | Objective Metrics | Subjective Metrics | Efficiency | |||||||

|---|---|---|---|---|---|---|---|---|---|---|

| FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAPcap ↑ | CLAPCoT ↑ | MOS-Q ↑ | MOS-A ↑ | Params | Time(s) ↓ | |

| GT | - | - | - | 0.55 | 0.28 | 0.45 | 4.37±0.21 | 4.56±0.19 | - | - |

| See&Hear | 118.95 | 2.26 | 2.30 | 1.20 | 0.32 | 0.35 | 2.75±1.08 | 2.87±0.99 | 415M | 19.42 |

| V-AURA† | 46.99 | 2.23 | 1.83 | 0.65 | 0.23 | 0.37 | 3.42±1.03 | 3.20±1.17 | 695M | 14.00 |

| FoleyCrafter | 39.15 | 2.06 | 1.89 | 1.21 | 0.41 | 0.34 | 3.08±1.21 | 2.63±0.88 | 1.20B | 3.84 |

| Frieren† | 74.96 | 2.55 | 2.64 | 1.00 | 0.37 | 0.34 | 3.27±1.11 | 2.95±1.09 | 159M | - |

| V2A-Mapper† | 48.10 | 2.50 | 2.34 | 1.23 | 0.38 | 0.32 | 3.31±1.02 | 3.16±1.04 | 229M | - |

| MMAudio | 43.26 | 1.65 | 1.40 | 0.44 | 0.31 | 0.40 | 3.84±0.89 | 3.97±0.82 | 1.03B | 3.01 |

| ThinkSound | 34.56 | 1.52 | 1.32 | 0.46 | 0.33 | 0.46 | 4.02±0.73 | 4.18±0.79 | 1.30B | 1.07 |

| w/o CoT Reasoning | 39.84 | 1.59 | 1.40 | 0.48 | 0.29 | 0.41 | 3.91±0.83 | 4.04±0.75 | 1.30B | 0.98 |

Estudios de ablación

Investigamos la contribución de cada componente para validar la efectividad de nuestras opciones de diseño, centrándonos en la codificación de texto y la integración multimodal.

Estrategias de codificación de texto

| Method | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAP ↑ |

|---|---|---|---|---|---|

| CLIP | 39.84 | 1.59 | 1.40 | 0.48 | 0.41 |

| T5 (CoT) | 37.65 | 1.54 | 1.35 | 0.46 | 0.44 |

| CLIP + T5 | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

Integración multimodal

| Integration | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAP ↑ |

|---|---|---|---|---|---|

| audio only | 37.13 | 1.58 | 1.37 | 0.50 | 0.43 |

| linear video | 38.96 | 1.58 | 1.38 | 0.46 | 0.45 |

| gated video | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

Impacto del tamaño del modelo

| Size | FD ↓ | KLPaSST ↓ | KLPaNNs ↓ | DeSync ↓ | CLAPCoT ↑ |

|---|---|---|---|---|---|

| Small | 40.80 | 1.64 | 1.38 | 0.46 | 0.41 |

| Medium | 36.80 | 1.56 | 1.34 | 0.46 | 0.44 |

| Large | 34.56 | 1.52 | 1.32 | 0.46 | 0.46 |

Preguntas frecuentes

ThinkSound es un marco de IA avanzado diseñado para generar y editar audio para videos. A diferencia de los modelos tradicionales, utiliza un proceso de razonamiento llamado Cadena de Pensamiento (CoT) para comprender el contexto de un video y crear un sonido de alta calidad y muy relevante, muy parecido a como lo haría un diseñador de sonido profesional.

La Cadena de Pensamiento permite que el modelo descomponga una tarea compleja (como "crear una banda sonora para este video") en pasos más pequeños y lógicos. Por ejemplo, primero podría identificar los objetos y acciones principales, luego razonar sobre la acústica del entorno y, finalmente, decidir los sonidos apropiados y su sincronización. Este proceso paso a paso conduce a una generación de audio más precisa y consciente del contexto.

Tres cosas principales: 1) Su uso del razonamiento CoT para una creación de sonido más inteligente. 2) Su interactividad, que permite a los usuarios editar audio, centrarse en objetos específicos y refinar el sonido utilizando lenguaje natural. 3) Está impulsado por AudioCoT, un conjunto de datos único creado específicamente para entrenar este tipo de generación de audio basada en el razonamiento.

¡Sí! Hemos proporcionado una demostración interactiva en Hugging Face Spaces, enlazada en la parte superior de esta página. También puede explorar el código fuente en GitHub para ejecutar el modelo usted mismo.